طورت شركة ميتا تقنية تعلم جديدة يطلق عليها اسم “Few-Shot Learner ”، تكتشف بسرعة المحتويات المحرضة على الكراهية.

طورت مجموعة ميتا ( شركة فيسبوك سابقاً) تقنية ذكاء اصطناعي جديدة، والتي تسمح لها بالتفاعل بسرعة أكبر مع المحتويات المحرضة على الكراهية والعنف والتآمر المنشورة على فيسبوك و إنستجرام.

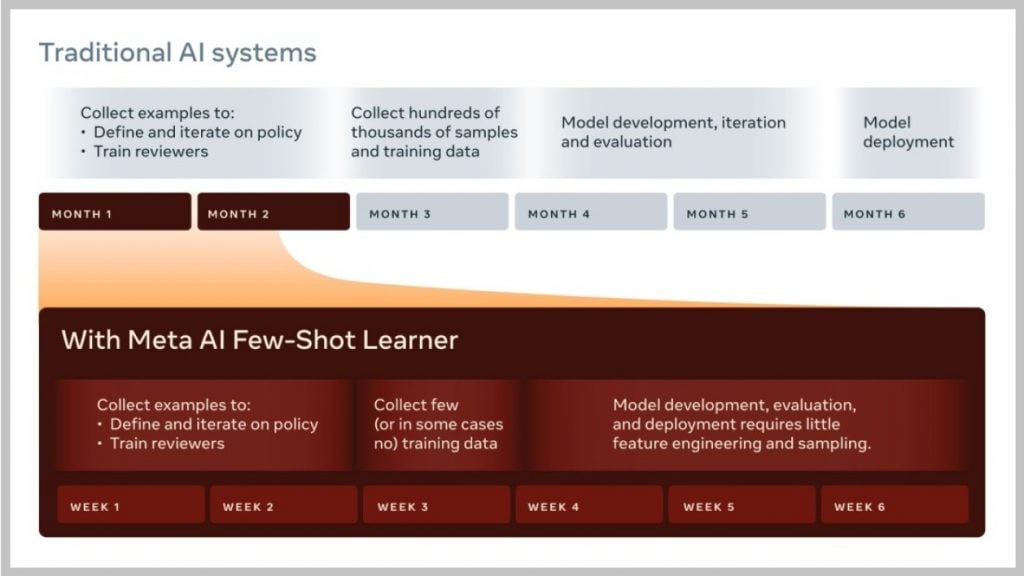

غالبًا ما يتصفح مؤلفو هذا النوع من الرسائل أحداثًا معينة ويسعون باستمرار لتجاوز أنظمة التصفية الحالية. ومع ذلك، يمكن أن يستغرق تكييف الذكاء الاصطناعي التقليدي شهورًا، حيث يجب جمع كمية كبيرة من بيانات التعلم وتصنيفها. وهو أمر صعب.

لهذا السبب ابتكر باحثو ميتا تقنية Few-Shot Learner (FSL)، والتي لا تتطلب سوى كمية صغيرة من بيانات التعلم لتصنيف العناصر الجديدة بشكل صحيح. النتيجة : نشر النموذج الجديد يمكن أن يتم بعد بضعة أسابيع، بدلا من عدة أشهر. حيث تعمل FSL بأكثر من مائة لغة.

الفكرة هي إنشاء نموذج لفهم اللغة يكون أكثر شمولية، وبالتالي أقل اعتمادًا على بيانات التعلم. تم تدريب هذا النموذج أولاً على “بلايين الأمثلة اللغوية العامة والمفتوحة المصدر”. بعد ذلك، يتم تغذية النظام بمحتوى محظور أو به مشاكل مصنفة بالفعل. باستخدام تقنيات التعلم تحت الإشراف الذاتي، يكفي بعد ذلك تقديم بضع عشرات من الأمثلة للمحتوى الإشكالي للنظام لإنشاء قاعدة التصفية الجديدة ضمنيًا وتلقائيًا.

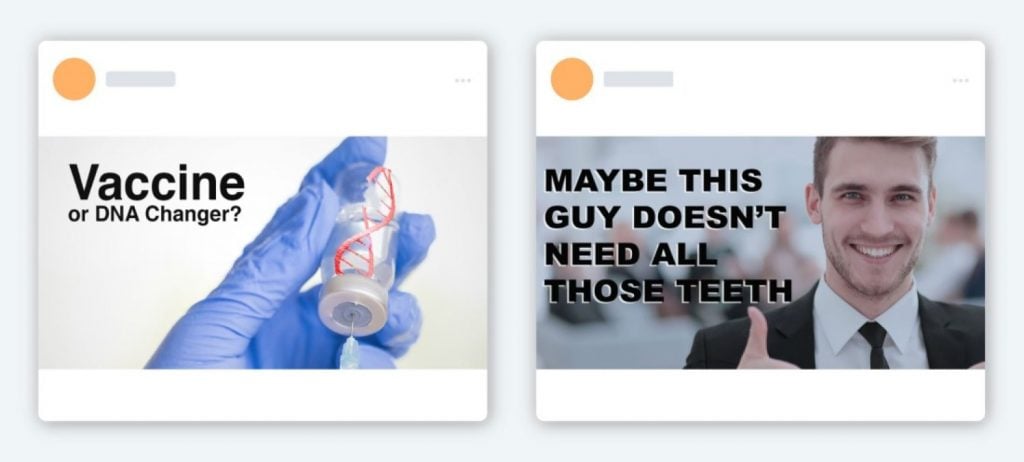

أظهرت الاختبارات التي تم إجراؤها أن طريقة عمل الأشياء هذه تسمح بتصفية المحتوى الإشكالي بسرعة، حتى لو كانت الصيغ مبتكرة أو غامضة. كان هذا هو الحال بشكل خاص مع المنشورات التي تحمل عنوان “لقاح أو تعديل الحمض النووي” (مؤامرة) و “ربما هذا الرجل لا يحتاج إلى كل أسنانه” (العنف).

إلى جانب هذا الاستخدام المحدد، تعد تقنية FSL الجديدة خطوة صغيرة أقرب إلى تحقيق الذكاء الاصطناعي، أي إنشاء نظام عام ومستقل تمامًا، على غرار الذكاء البشري.